Densepose——基于UV坐标的高精度姿态估计

DensePose From WIFI —— Jiaqi Gen

文献综述:《DensePose From WiFi》

目的:论文旨在解决传统人体姿态估计方法面临的三大核心问题:

- 环境限制:RGB 相机在光照不佳或存在遮挡时性能会急剧下降;

- 成本与功耗:LiDAR 和雷达等传感器价格昂贵且功耗高,难以在家庭等日常场景普及;

- 隐私问题:在浴室、卧室等私密空间部署摄像头会引发严重的隐私担忧。

论文的最终目的是开发一种低成本、易于部署、保护隐私且对光照和遮挡鲁棒的新型人体感知技术,为智能家居、健康监护等应用铺平道路。

遇到的困难:

- CSI是一维数据,与空间域的信息没有相关性,不像图片,每一个像素点都是是空间域的一个映射;

- 前人没有相关研究,都是基于TOF、AOA的中心定位;

研究方法:

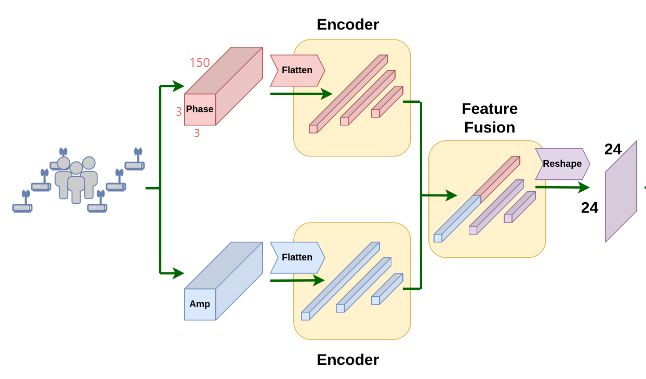

大致流程如下:首先采集信号的CSI,对CSI的幅值和相位进行预处理,包括采样、插值以及数据矫正。之后通过一个双支编码器,将幅值和相位vector编码为2D的feature maps,对应图像姿态识别中的原始图像(这里做了一个域转换:从WIFI信号域 → Feature Maps特征域; 1D → 2D)。最后类似于图像姿态识别,将2D的feature maps作为输入,得到最后的UV coordinates。

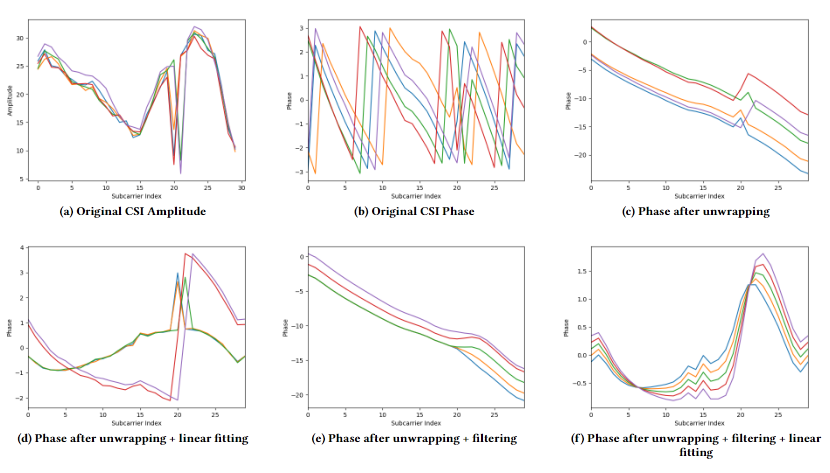

- 数据预处理:对原始的信道状态信息(CSI)进行“相位净化”(Phase Sanitization),包括相位解包裹(unwrapping)、中值/均值滤波去噪和线性拟合,以获得稳定可靠的相位信息。

- 模态转换网络(Modality Translation Network):设计了一个双分支(幅度和相位)编码器-解码器网络。将CSI展平后输入编码器而不是通过卷积压缩,因为可能每一对收发天线的一个CSI都可以表征完整的空间信息。编码器使用MLP(而非CNN)将1D的CSI张量(150x3x3)映射到潜在空间,然后融合并重塑为2D特征图(24x24),再通过卷积和反卷积层上采样,最终输出一个模拟图像域的3x720x1280特征图。

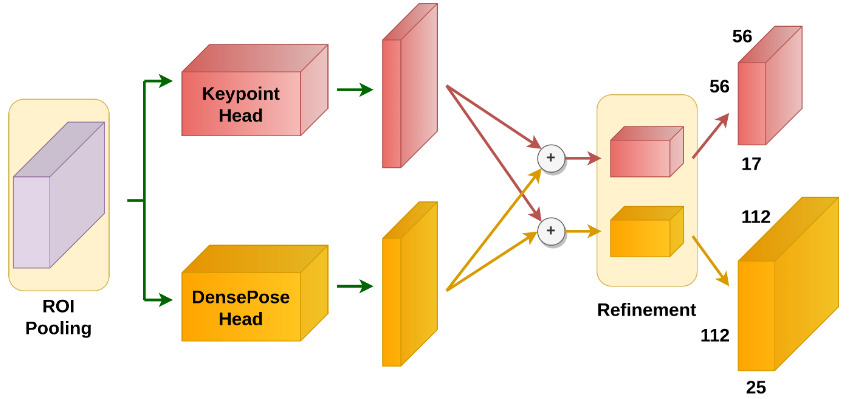

- WiFi-DensePose RCNN:将上述生成的2D特征图输入到一个修改版的 DensePose-RCNN 架构中。该架构采用 ResNet-FPN 作为骨干网络,并包含两个并行的预测头:一个用于预测24个身体部位的UV坐标(DensePose Head),另一个用于预测17个人体关键点的热力图(Keypoint Head),以提供额外的监督和约束。

- 迁移学习:为了加速训练并提升性能,论文采用了一种教师-学生框架。一个在COCO数据集上预训练的图像版 DensePose 模型作为“教师”,指导“学生”(即本文的WiFi模型)使其在多个层级的特征图上与教师模型的输出尽可能相似(通过MSE损失)。

- 损失函数:总损失包含目标检测损失(分类

Lcls和边界框回归Lbox)、DensePose损失Ldp(分割和UV回归)、关键点损失Lkp和迁移学习损失Ltr。

创新点

- 首创性任务:首次提出并成功实现了仅使用WiFi信号进行稠密人体姿态估计的任务,将WiFi感知的粒度从稀疏关键点提升到了稠密表面级别。

- 突破物理限制:通过深度学习模型,成功地从理论上定位精度仅为0.5米的WiFi信号中,恢复出了远超此精度的稠密人体姿态,突破了传统ToF/AoA方法的物理瓶颈。

- 新颖的网络架构:

- 模态转换网络:创新性地使用MLP而非CNN来处理CSI数据的3x3维度,认为其代表的是全局场景摘要而非局部空间信息,并通过编码器-解码器结构将其转换为类图像的2D特征图。

- 相位净化方法:提出了一套有效的相位处理流程,充分挖掘了通常被忽视的CSI相位信息的价值。

- 有效的训练策略:通过引入关键点检测分支和从图像模型迁移学习,显著提升了模型的训练效率和最终性能,为解决数据匮乏问题提供了新思路。

研究结果:

- 定量结果:在“相同布局”(Same Layout)的测试协议下,模型在人体检测(AP@50=87.2)和稠密姿态估计(dpAP·GPS@50=79.3)上取得了不错的效果,表明其能有效定位人体并估计大致姿态。但在更严格的指标(如AP@75, dpAP·GPS@75)上性能下降,说明对肢体等细节的估计仍有不足。

- 定性结果:可视化结果(图9, 10)显示,WiFi模型的预测结果与基于图像的DensePose结果在主体轮廓和主要关节位置上具有较高的一致性,验证了方法的可行性。

- 消融实验:证明了相位信息、关键点分支和迁移学习均能有效提升模型性能。特别是关键点分支对提升细节(如肢体)的估计效果显著。

- 跨域泛化:在“不同布局”(Different Layout)协议下,性能大幅下降(AP从43.5降至27.3),表明模型对环境变化非常敏感,泛化能力是当前的主要瓶颈。

可能的改进之处:

- 泛化能力:最大的问题是模型在不同环境布局下的泛化性能差。未来工作需要收集更多样化的多布局数据,或研究更鲁棒的域自适应/域泛化方法。

- 3D姿态与形状:论文目前输出的是2D UV坐标,未来可探索直接从WiFi信号恢复3D人体姿态甚至形状(如SMPL模型)。

- 实时性与轻量化:当前模型训练耗时长(约80小时),推理速度未提及。未来可研究模型压缩或设计更轻量级的网络以适应边缘设备。

- 多人场景与遮挡:论文指出在三人及以上或罕见姿态场景下性能会下降,需要更强大的网络或数据增强策略来解决。

- 数据依赖:模型依赖于用图像模型生成的伪标签进行训练,这引入了误差。未来可探索自监督或弱监督学习方法。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Katarina's diary!